MindIE介绍

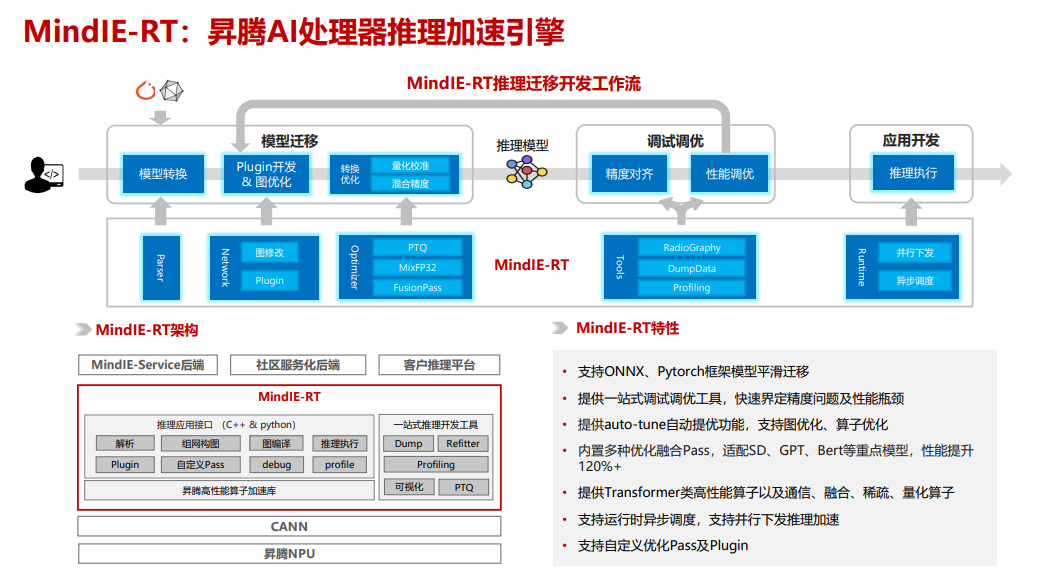

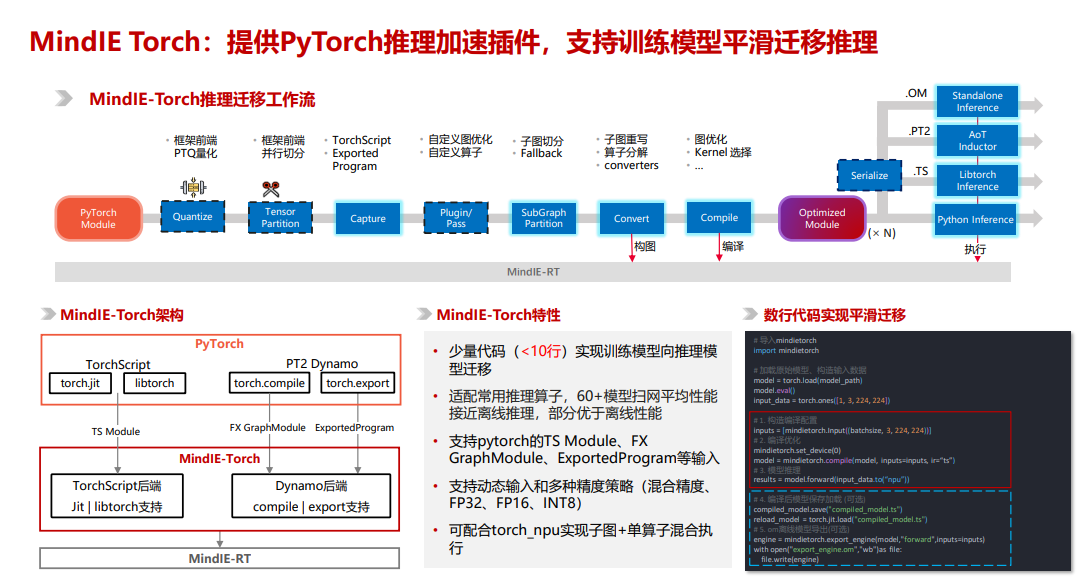

昇腾推理引擎:快速迁移、高效压缩、调试调优、服务对接。

MindIE整体介绍

昇腾推理引擎:快速迁移、高效压缩、调试调优、服务对接

MindIE LLM整体架构

MindIE LLM是MindIE解决方案下的大语言模型推理组件,基于昇腾硬件提供业界通用大模型推理能力,同时提供多

并发请求的调度功能,支持Continuous Batching、PageAttention、FlashDecoding等加速特性,使能用户高性

能推理需求MindIE LLM主要提供大模型推理Python API和大模型调度C++ API

MindIE LLM总体架构分为三层:

1.Modeling:提供深度定制优化的模块和内置模型,支持ATB Models和Mindspore Models两种框架。

2.Text Generator:负责模型配置、初始化、加载、自回归推理流程、后处理等,向LLM Manager提供统一的自回归

推理接口,支持并行解码插件化运行。

3.LLM Manager:负责状态管理及任务调度,基于调度策略实现用户请求组batch,统一内存池管理kv缓存,返回推

理结果,提供状态监控接口。

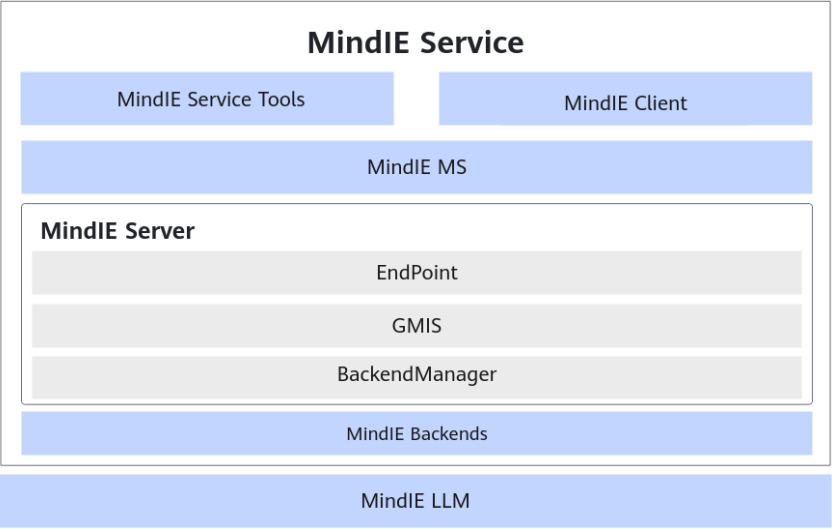

MindIE Service:昇腾服务化框架

MindlE-Service:提供推理服务化部署和运维能力

MindlE Service Tools:昇腾推理服务化工具;主要功能有大模型推理性能测试、精度测试和可视化能力,并且支持通过配置提升吞吐。

MindlE Client:昇腾推理服务化完整的Client客户端;配套昇腾推理服务化MindlE Server提供完整的推理服务化能力,包括对接MindlE Server的通信协议、请求和返回的接口,提供给用户应用对接。

MindIE MS:服务策略管理,提供服务运维能力。主要功能包括模型Pod级和Pod内实例级管理简化部署并提供服务质量监控、模型更新、故障重调度和自动扩缩负载均衡能力,不仅能够提升服务质量,同时也能提高推理硬件资源利用率。

MindlE Server:推理服务端;提供模型推理服务化能力,支持命令行部署RESTfuI服务。

EndPoint:提供RESTful接口;EndPoint面向推理服务开发者提供RESTful接口,推理服务化协议和接口封装,支持Triton/OpenAI/TGI/VLLM主流推理框架请求接口。

GMIS:模型推理调度器,提供多实例调度能力;实现从推理任务调度到任务执行的可扩展架构,适应各类推理方法。

BackendManager:模型执行后端,腾后端和自定义后端的管理模块;Backend管理模块面向不同推理引擎,不同模型,提供统一抽象接口,便于扩展,减少推理引擎、模型变化带来的修改。

MindlE Backends:支持昇腾MindIE LLM后端.

MindIE LLM:提供大模型推理能力,同时提供多并发请求的调度功能。

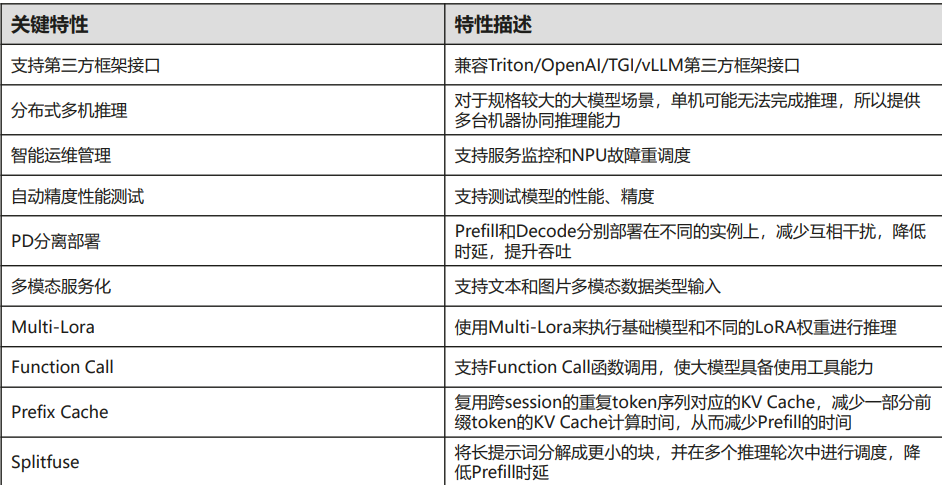

服务化支持的特性总览表

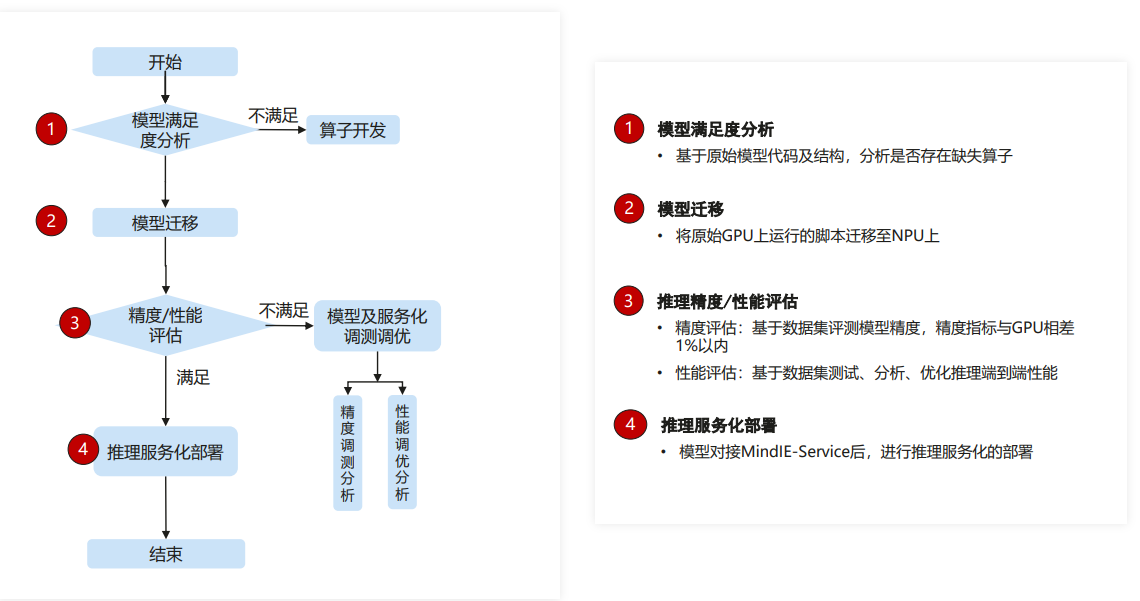

昇腾大模型推理迁移全流程

昇腾计算产业是基于昇腾系列(HUAWEI Ascend)处理器和基础软件构建的全栈 AI计算基础设施、行业应用及服务,https://devpress.csdn.net/organization/setting/general/146749包括昇腾系列处理器、系列硬件、CANN、AI计算框架、应用使能、开发工具链、管理运维工具、行业应用及服务等全产业链

更多推荐

已为社区贡献2条内容

已为社区贡献2条内容

所有评论(0)