智能家居控制接口:vLLM部署指令解析模型实战

本文介绍了如何在星图GPU平台上自动化部署Vllm-v0.11.0镜像,以构建智能家居指令解析服务。该平台简化了部署流程,用户可快速搭建基于大语言模型的推理环境。部署后的核心应用场景是将用户模糊的自然语言指令(如“调暗客厅灯光”)精准解析为机器可执行的JSON控制命令,从而提升智能家居系统的交互体验。

智能家居控制接口:vLLM部署指令解析模型实战

1. 引言:当智能家居遇上大模型

你有没有遇到过这样的场景?对着家里的智能音箱说“把客厅的灯调暗一点”,结果它要么没反应,要么把卧室的灯给关了。或者想用语音控制扫地机器人“去打扫一下厨房”,它却开始在客厅里转圈。这些尴尬,核心问题往往出在指令的识别和理解上。

传统的语音识别和自然语言处理方案,在处理复杂、多变的家庭指令时,常常力不从心。它们可能能听懂单个词,但难以理解整句话的意图和上下文。比如“我有点冷”和“把空调温度调高两度”,对人类来说是同一个意思,但对机器来说可能就是两个完全不同的指令。

今天,我们要解决的就是这个问题。通过部署一个基于大语言模型的指令解析服务,让智能家居真正“听懂”人话。而实现这一切的关键,是一个名为vLLM的高性能推理框架。它能让我们用普通的硬件,跑出专业级的模型响应速度,把原本需要高端服务器才能运行的大模型,轻松部署到你的开发环境甚至家庭服务器上。

这篇文章,我就手把手带你走一遍完整的实战流程。从为什么选vLLM,到怎么快速部署,再到如何用它构建一个智能家居指令解析接口。你会发现,让机器理解人类语言,并没有想象中那么复杂。

2. 为什么是vLLM?速度与效率的革命

在深入代码之前,我们得先搞清楚,为什么在众多推理框架中,我强烈推荐vLLM。答案很简单:它能让你的模型跑得飞快,同时还能省下不少内存。

2.1 传统方案的瓶颈

在vLLM出现之前,部署一个大语言模型服务,通常会遇到几个头疼的问题:

- 内存占用大:模型参数、注意力机制的键值对(Key-Value Cache)会吃掉大量内存,尤其是处理长文本或高并发请求时。

- 吞吐量低:一次只能处理少量请求,用户一多就得排队,体验很差。

- 部署复杂:为了提升性能,往往需要复杂的工程优化,门槛很高。

这就好比你想在家里开个小超市(提供模型服务),但货架(内存)又贵又小,理货员(计算资源)效率还低,结果就是顾客(用户请求)等得不耐烦。

2.2 vLLM的“王牌”:PagedAttention

vLLM解决上述问题的核心技术,叫做 PagedAttention。你可以把它理解成电脑操作系统的“虚拟内存”或“内存分页”技术。

- 传统Attention:就像你必须把一整本书都摊在桌面上才能查找内容,不管你看的是一页还是一章。

- PagedAttention:它把这本书分成了很多“页”。当你需要查找时,只把相关的几页拿到桌面上,其他页可以暂时收起来。桌面上(GPU显存)放不下的页,就先放到书架(CPU内存)上,需要时再换进来。

这项技术带来的好处是颠覆性的:

- 显著降低内存占用:同样大小的“桌子”(显存),现在能同时“翻阅”更多本书(处理更多请求)。

- 大幅提升吞吐量:因为内存利用率高了,可以同时处理更多用户请求,整体服务能力飙升。

- 高效管理长序列:对于智能家居场景,用户指令可能带有上下文(比如“刚才说的那个灯”),PagedAttention能更高效地管理这些长对话历史。

官方数据显示,vLLM可以将推理速度提升5到10倍。这意味着,你用vLLM部署的服务,响应速度能快一个数量级,同时服务更多用户。

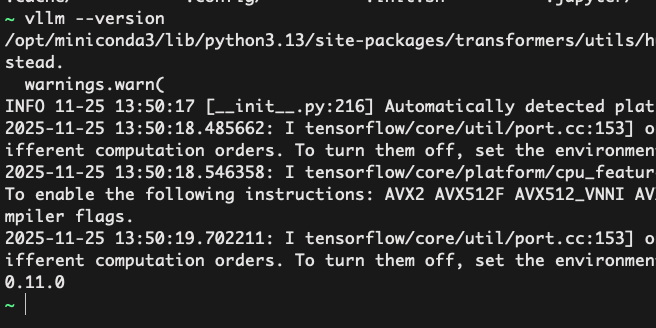

2.3 我们的选择:vLLM-v0.11.0镜像

为了让大家能最快上手,避免繁琐的环境配置,我们直接使用一个预置好的 vLLM-v0.11.0 镜像。这个镜像就像是一个已经装好所有软件和驱动程序的“游戏主机”,你插上电(启动容器)就能直接玩(部署模型)。

它主要帮我们做了两件事:

- 环境集成:预装了vLLM推理引擎、Python依赖、常用工具(如Jupyter),开箱即用。

- 优化配置:针对模型推理进行了基础的系统优化,让我们能更专注于应用开发。

接下来,我们就启动这个“游戏主机”,开始构建我们的智能家居大脑。

3. 实战第一步:快速部署vLLM服务

理论说再多,不如动手跑一行代码。我们有两种方式来使用这个镜像:一种是适合交互式探索的Jupyter Notebook,另一种是适合长期运行服务的SSH连接。你可以根据喜好选择。

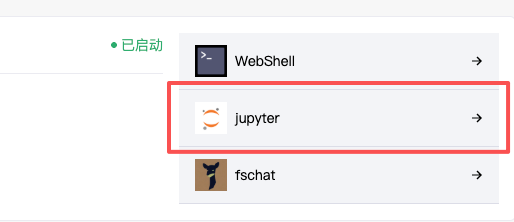

3.1 方法一:通过Jupyter Notebook交互式开发

对于初学者或者想快速验证想法的人来说,Jupyter Notebook是最友好的方式。它就像一个在浏览器里运行的代码实验室。

操作步骤:

- 启动镜像:在你的云平台或本地Docker环境中,找到并启动

vLLM-v0.11.0镜像,选择以Jupyter模式运行。 - 获取访问信息:镜像启动后,你会获得一个访问链接(通常包含IP地址和端口号,例如

http://127.0.0.1:8888)和一个登录令牌(Token)。 - 打开浏览器:将链接复制到浏览器中打开,输入令牌,你就进入了JupyterLab界面。

- 新建Notebook:点击“新建”按钮,创建一个Python 3 Notebook,我们的代码都将在这里编写和运行。

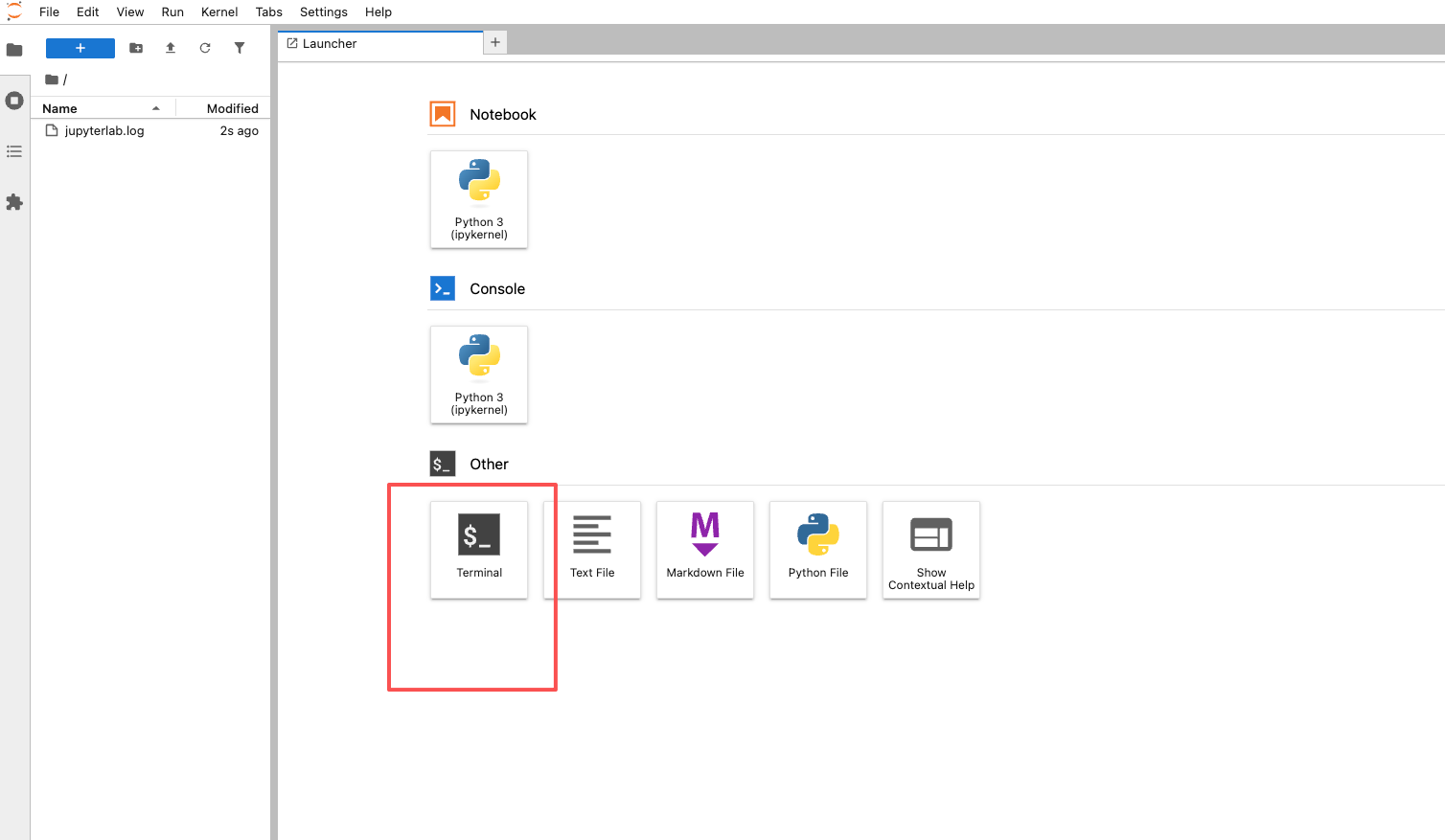

进入JupyterLab后,界面清晰,可以轻松创建新的笔记本来写代码。

进入JupyterLab后,界面清晰,可以轻松创建新的笔记本来写代码。

选择“Python 3”内核,创建一个全新的代码单元格,准备开始我们的部署。

选择“Python 3”内核,创建一个全新的代码单元格,准备开始我们的部署。

优点:每一步都能看到输出,方便调试和教学,非常适合学习和原型开发。

3.2 方法二:通过SSH连接进行服务部署

如果你打算部署一个长期运行的后台服务,SSH是更专业和稳定的选择。它让你能像操作一台远程服务器一样操作这个容器。

操作步骤:

- 启动镜像并开启SSH:在启动镜像时,确保开启SSH服务功能。镜像会为你生成SSH连接的IP、端口和密码。

- 连接服务器:打开你的终端(Windows可用PowerShell或CMD,Mac/Linux直接用终端),使用得到的IP、端口和密码进行连接。

ssh -p <端口号> root@<IP地址> # 输入密码后,你就进入了容器的命令行环境 - 进入工作目录:连接成功后,你就可以像使用Linux服务器一样,安装包、运行Python脚本、启动服务。

在镜像管理页面,找到SSH连接所需的IP、端口和密码。

在镜像管理页面,找到SSH连接所需的IP、端口和密码。

在终端中成功通过SSH连接到vLLM容器,可以执行各种命令。

在终端中成功通过SSH连接到vLLM容器,可以执行各种命令。

优点:更接近生产环境,适合运行后台进程,资源占用更纯粹。

无论选择哪种方式,当你看到命令行提示符或者Jupyter界面时,就说明我们的“游戏主机”已经准备就绪。接下来,我们就要在里面安装和启动我们的“游戏软件”——大语言模型。

4. 核心实战:部署指令解析模型服务

环境准备好了,现在我们来部署真正的“大脑”。我们将以一个轻量级但能力不错的开源模型为例,比如 Qwen2.5-7B-Instruct。它体积适中,指令跟随能力强,非常适合我们的智能家居场景。

4.1 启动vLLM模型服务器

在Jupyter的一个代码单元格中,或者SSH连接的终端里,输入并执行以下命令:

# 这是一个在后台启动vLLM服务的示例命令

# 你可以直接复制到终端中运行,注意替换你的模型路径和端口

!python -m vllm.entrypoints.openai.api_server \

--model /path/to/your/qwen2.5-7b-instruct \ # 模型存放的本地路径

--served-model-name home-assistant-llm \ # 你给这个服务起的名字

--api-key your-api-key-here \ # 设置一个API密钥,增加安全性

--port 8000 \ # 服务监听的端口号

--max-model-len 4096 \ # 模型支持的最大上下文长度

--tensor-parallel-size 1 # 如果只有一张GPU,就设为1

命令参数解读(用大白话解释):

--model:告诉vLLM你要启动哪个模型。你需要提前从网上下载好模型文件,放到镜像里的某个目录,然后把路径填在这里。--served-model-name:给你的服务起个名字,后面调用的时候会用上。--api-key:相当于给你的服务加把锁,只有知道钥匙(API Key)的人才能调用。生产环境一定要设置。--port 8000:服务在8000号端口“开门营业”。--max-model-len 4096:模型一次最多能处理4096个字符的对话(包括你的问题和它的回答)。对于智能家居指令,完全够用。--tensor-parallel-size 1:如果你只有一张显卡,就写1。有多张显卡可以写更大的数字来加速。

执行这个命令后,你会看到一大堆日志输出,最后如果看到类似 "Uvicorn running on http://0.0.0.0:8000" 的信息,就恭喜你,模型服务器启动成功了!它现在正在8000端口等待我们的指令。

4.2 编写一个简单的测试客户端

服务跑起来了,我们得试试它灵不灵。再打开一个Jupyter单元格,或者新的终端窗口,写一个简单的Python脚本来测试。

# test_client.py

import openai

import time

# 1. 配置客户端,指向我们刚刚启动的vLLM服务器

client = openai.OpenAI(

api_key="your-api-key-here", # 填写你启动服务时设置的API Key

base_url="http://localhost:8000/v1" # vLLM服务默认的OpenAI兼容接口地址

)

# 2. 构造一个智能家居场景的测试指令

test_messages = [

{"role": "system", "content": "你是一个智能家居控制助手,负责将用户模糊的自然语言指令,解析成明确的、可执行的JSON格式命令。只输出JSON,不要有任何额外解释。"},

{"role": "user", "content": "我觉得客厅太亮了,稍微调暗一点吧。"}

]

print("发送指令:", test_messages[-1]['content'])

print("正在解析...")

# 3. 发送请求到我们的模型服务

try:

response = client.chat.completions.create(

model="home-assistant-llm", # 这里填写你启动服务时设置的 --served-model-name

messages=test_messages,

temperature=0.1, # 温度设低一点,让输出更稳定、更可控

max_tokens=150 # 限制回复长度,对于指令解析足够了

)

# 4. 打印出模型解析的结果

reply = response.choices[0].message.content

print("\n解析结果:")

print(reply)

except Exception as e:

print(f"请求出错:{e}")

运行这个脚本,如果你的服务一切正常,你应该会看到模型返回了一个JSON字符串。它可能会把“客厅太亮,调暗一点”解析成类似下面的结构:

{"action": "adjust_light", "location": "living_room", "device": "main_light", "property": "brightness", "value": "-20%"}

这个JSON结构清晰定义了要执行的动作(adjust_light)、位置(living_room)、设备(main_light)、属性(brightness)和具体值(-20%)。你的智能家居中枢收到这个JSON后,就可以精准地执行操作了。

5. 构建智能家居指令解析接口

现在,我们已经有了一个能听懂话并输出JSON的模型服务。接下来,我们要把它包装成一个标准的、可供其他智能家居设备调用的API接口。这里我们用轻量级的 FastAPI 框架来实现。

5.1 创建FastAPI应用

在vLLM容器内,安装FastAPI和相关的库,然后创建一个新的Python文件,比如 home_assistant_api.py。

# home_assistant_api.py

from fastapi import FastAPI, HTTPException, Security

from fastapi.security import HTTPBearer, HTTPAuthorizationCredentials

from pydantic import BaseModel

import openai

import json

import logging

# 设置日志,方便查看运行情况

logging.basicConfig(level=logging.INFO)

logger = logging.getLogger(__name__)

# 创建FastAPI应用实例

app = FastAPI(title="智能家居指令解析API", description="将自然语言指令转换为可执行的JSON命令")

security = HTTPBearer()

# 配置连接到我们的vLLM模型服务

# 注意:这里的配置应该来自环境变量或配置文件,这里写死是为了演示

VLLM_API_BASE = "http://localhost:8000/v1"

VLLM_API_KEY = "your-api-key-here"

VLLM_MODEL_NAME = "home-assistant-llm"

client = openai.OpenAI(api_key=VLLM_API_KEY, base_url=VLLM_API_BASE)

# 定义请求体的数据模型

class InstructionRequest(BaseModel):

"""用户指令请求"""

user_input: str # 用户说的自然语言,例如:“打开卧室的空调,调到26度”

session_id: str = None # 可选的会话ID,用于处理多轮对话上下文

user_context: dict = None # 可选的用户上下文,比如用户偏好的设备名称

# 定义响应体的数据模型

class CommandResponse(BaseModel):

"""解析后的命令响应"""

success: bool

command: dict # 解析出的JSON命令

raw_llm_response: str = None # 模型的原始回复,用于调试

error_message: str = None

# 系统提示词,用于引导模型行为

SYSTEM_PROMPT = """

你是一个智能家居指令解析器。你的任务是将用户输入的自然语言指令,转换为一个结构化的、无歧义的JSON命令。

JSON必须包含以下字段(如果适用):

- action: 执行的动作,如 "turn_on", "turn_off", "adjust", "query_status"

- location: 设备所在位置,如 "living_room", "bedroom", "kitchen"

- device_type: 设备类型,如 "light", "air_conditioner", "tv", "curtain"

- device_name: 设备具体名称(可选),如 "main_light", "bedside_lamp"

- property: 要控制的属性,如 "brightness", "temperature", "channel"

- value: 属性的目标值,如 "50%", "26", "CCTV-1"

如果指令不明确,请根据常识进行合理推断。如果无法解析,请将action设为"unclear"。

只输出JSON对象,不要有任何额外的解释、标记或文字。

"""

@app.post("/parse", response_model=CommandResponse)

async def parse_instruction(

request: InstructionRequest,

credentials: HTTPAuthorizationCredentials = Security(security)

):

"""

解析自然语言指令为JSON命令。

"""

# 1. 简单的权限验证(实际生产环境应更复杂)

if credentials.credentials != VLLM_API_KEY:

raise HTTPException(status_code=403, detail="无效的API密钥")

logger.info(f"收到解析请求,会话ID: {request.session_id}, 输入: {request.user_input}")

# 2. 构建发送给大模型的对话消息

messages = [

{"role": "system", "content": SYSTEM_PROMPT},

]

# 如果有用户上下文(比如他习惯把客厅大灯叫“顶灯”),可以在这里加入

if request.user_context:

context_str = json.dumps(request.user_context, ensure_ascii=False)

messages.append({"role": "system", "content": f"用户自定义设备别名为:{context_str}"})

messages.append({"role": "user", "content": request.user_input})

try:

# 3. 调用vLLM服务

llm_response = client.chat.completions.create(

model=VLLM_MODEL_NAME,

messages=messages,

temperature=0.1, # 低温度保证输出稳定

max_tokens=200,

)

raw_content = llm_response.choices[0].message.content.strip()

logger.info(f"模型原始回复: {raw_content}")

# 4. 尝试解析模型返回的JSON

# 模型有时会在JSON外加引号或代码块标记,这里做一下清理

if raw_content.startswith("```json"):

raw_content = raw_content[7:-3].strip()

elif raw_content.startswith("```"):

raw_content = raw_content[3:-3].strip()

parsed_command = json.loads(raw_content)

# 5. 返回成功响应

return CommandResponse(

success=True,

command=parsed_command,

raw_llm_response=raw_content

)

except json.JSONDecodeError as e:

logger.error(f"JSON解析失败: {e}, 原始内容: {raw_content}")

return CommandResponse(

success=False,

command={},

raw_llm_response=raw_content,

error_message=f"无法解析模型输出为JSON: {str(e)}"

)

except Exception as e:

logger.error(f"处理请求时发生未知错误: {e}")

return CommandResponse(

success=False,

command={},

error_message=f"内部服务器错误: {str(e)}"

)

@app.get("/health")

async def health_check():

"""健康检查端点,用于监控服务是否存活"""

return {"status": "healthy", "service": "smart_home_parser"}

if __name__ == "__main__":

import uvicorn

# 启动API服务,监听在8080端口

uvicorn.run(app, host="0.0.0.0", port=8080)

5.2 启动并测试API接口

保存好上面的代码后,在终端中运行:

python home_assistant_api.py

看到 Uvicorn running on http://0.0.0.0:8080 的提示,说明你的指令解析API已经上线了!

现在,你可以用任何工具来测试它,比如 curl 命令或者更直观的 Postman。

使用curl测试:

curl -X POST "http://localhost:8080/parse" \

-H "Authorization: Bearer your-api-key-here" \

-H "Content-Type: application/json" \

-d '{"user_input": "晚上睡觉前,帮我把卧室的灯关了,空调设成睡眠模式"}'

如果一切顺利,你会收到一个JSON响应,其中 command 字段可能就是:

{

"action": "turn_off",

"location": "bedroom",

"device_type": "light"

}

{

"action": "set_mode",

"location": "bedroom",

"device_type": "air_conditioner",

"property": "mode",

"value": "sleep"

}

(注:实际中,一个复杂指令可能需要模型输出包含多个命令的数组,上述代码是简化版。你可以修改提示词和解析逻辑来支持多命令输出。)

你的智能家居中枢(比如Home Assistant、小米网关等)就可以定期调用这个 /parse 接口,将用户的语音转文字结果发过来,拿到结构化的命令后,再去控制具体的设备。

6. 总结与展望

走到这里,我们已经完成了一个从0到1的智能家居指令解析服务。让我们回顾一下关键步骤和收获:

- 选择了正确的引擎:我们使用 vLLM 作为推理框架,凭借其 PagedAttention 核心技术,解决了大模型部署中的内存和吞吐量瓶颈,让高性能模型服务在普通资源上成为可能。

- 利用了现成的跑道:通过 vLLM-v0.11.0镜像,我们跳过了复杂的环境配置,直接获得了开箱即用的高性能推理环境,无论是通过 Jupyter 交互探索,还是通过 SSH 部署服务,都非常便捷。

- 构建了核心大脑:我们部署了一个大语言模型(如Qwen2.5),并让它扮演“指令翻译官”的角色,将用户模糊的“人话”转换成精准的、机器可读的 JSON命令。

- 封装了友好接口:我们使用 FastAPI 创建了一个标准的RESTful API,为智能家居中枢提供了一个简单、安全的调用方式,完成了从技术模块到可用服务的最后一公里。

这个方案的直接价值是显而易见的:它极大地提升了智能家居的理解能力和用户体验。用户不再需要死记硬背固定的命令句式,可以像对家人说话一样自然地控制设备。

展望未来,你还可以在这个基础上做很多有趣的扩展:

- 多轮对话:让模型记住上下文,处理“把亮度再调低一点”这样的指代性指令。

- 个性化学习:根据用户习惯,自动学习“我房间的灯”指代的是哪个具体设备。

- 多模态融合:结合视觉模型,实现“关掉屏幕上正在闪的那个灯”这类需要“看”的指令。

- 本地知识库:接入设备手册、家庭布局图,让模型更了解你家中的设备具体情况。

技术的最终目的是服务于生活。通过vLLM这样高效的工具,我们将曾经需要庞大算力支撑的AI能力,轻松带入了家庭场景。希望这篇实战指南能为你打开一扇门,开始构建更智能、更懂你的家居环境。

获取更多AI镜像

想探索更多AI镜像和应用场景?访问 CSDN星图镜像广场,提供丰富的预置镜像,覆盖大模型推理、图像生成、视频生成、模型微调等多个领域,支持一键部署。

昇腾计算产业是基于昇腾系列(HUAWEI Ascend)处理器和基础软件构建的全栈 AI计算基础设施、行业应用及服务,https://devpress.csdn.net/organization/setting/general/146749包括昇腾系列处理器、系列硬件、CANN、AI计算框架、应用使能、开发工具链、管理运维工具、行业应用及服务等全产业链

更多推荐

已为社区贡献18条内容

已为社区贡献18条内容

所有评论(0)