translategemma-4b-it部署实践:Ollama在国产昇腾910B上适配图文翻译的初步验证

本文介绍了如何在星图GPU平台上自动化部署【ollama】translategemma-4b-it镜像,实现图文翻译功能。该平台简化了部署流程,用户可快速搭建翻译服务,应用于处理包含外文的图片、文档截图等场景,实现高效、准确的跨语言信息转换。

translategemma-4b-it部署实践:Ollama在国产昇腾910B上适配图文翻译的初步验证

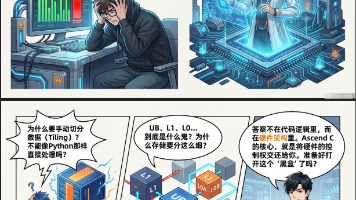

想不想让电脑像专业翻译官一样,不仅能看懂图片里的外文,还能准确翻译出来?今天要聊的translategemma-4b-it模型,就能帮你实现这个想法。这是一个专门做翻译的AI模型,特别的是,它不仅能翻译纯文字,还能“看懂”图片里的文字并翻译出来。

更让人兴奋的是,我们这次把它部署在了国产的昇腾910B硬件平台上,用Ollama这个工具来管理。这意味着什么?意味着我们可以在完全自主可控的国产算力上,跑起来一个世界级的翻译AI。接下来,我就带你一步步看看怎么把它搭起来,以及它实际用起来到底怎么样。

1. 认识translategemma-4b-it:你的图文翻译小助手

在动手之前,我们先花几分钟了解一下这个工具到底是什么,能干什么。

1.1 模型简介:轻量但强大的翻译专家

Translategemma-4b-it是Google基于Gemma 3模型系列打造的一个开源翻译模型。它的核心目标很明确:专业做翻译,而且是图文都能翻的那种。

这个模型有几个特点很吸引人:

- 专精翻译:不像有些通用模型什么都能聊但什么都不精,它就是为了翻译任务优化的,在55种语言之间互译表现更专业。

- 图文双修:最大的亮点是支持“图生文”翻译。你给它一张包含文字的图片,它能先识别图中的文字,再翻译成目标语言。

- 身材轻巧:名字里的“4b”指的是40亿参数,在AI模型里算是个“小个子”。这意味着它对硬件要求相对友好,更容易在各种设备上跑起来,包括我们今天用的昇腾910B平台。

- 输入输出明确:

- 吃进去的:一段待翻译的文本,或者一张图片(模型会自己处理成896x896的大小)。

- 吐出来的:翻译好的目标语言文本,干净利落,没有多余的废话。

简单来说,你可以把它想象成一个掌握了55门语言的、眼神还特别好的翻译员,既能把文档交给他翻译,也能把一张外语海报递给他,让他读出来并翻译成中文。

1.2 为什么选择Ollama + 昇腾910B这个组合?

你可能听说过很多部署AI模型的方式,为什么我们选了这个组合?这里面的考虑其实挺实际的。

Ollama的角色:模型管家 Ollama就像一个专门管理AI模型的“应用商店”加“启动器”。它的好处是:

- 操作简单:通常一条命令就能把模型拉下来并运行起来,省去了复杂的环境配置。

- 统一管理:可以方便地切换、运行不同的模型。

- 社区活跃:有丰富的模型库和教程支持。

昇腾910B的背景:国产算力基石 在国产AI芯片领域,昇腾910B是一个重要的角色。选择它进行适配和验证,背后的意义超出了技术本身:

- 自主可控:在关键应用场景下,使用国产硬件平台能更好地保障技术链的安全。

- 生态验证:验证像Ollama这样的流行开源工具链在国产平台上的兼容性和性能,有助于整个生态的成熟。

- 探索可能性:为更多优秀的开源AI模型在国产算力平台上的落地,摸索一条可行的路径。

这次实践,就是一次“把世界级的开源AI模型,通过流行的开源工具,跑在国产算力上”的尝试。

2. 环境准备与Ollama部署

理论说完了,我们开始动手。这一部分会详细说明如何在昇腾910B的环境下,为translategemma-4b-it模型的运行做好准备。

2.1 基础系统环境确认

由于昇腾910B平台有其特定的软件栈要求(如CANN),我们假设你已经拥有了一个基础的、支持昇腾NPU运行的Linux系统环境。部署前,请确认以下几点:

- 操作系统:建议使用Ubuntu 20.04或22.04等已验证兼容的系统版本。

- 昇腾驱动与CANN:确保昇腾NPU的驱动和异构计算架构CANN(Compute Architecture for Neural Networks)已正确安装。这是模型能在910B上加速运算的基础。

- 容器环境(可选但推荐):使用Docker或类似容器技术可以更好地隔离环境,避免依赖冲突。昇腾官方通常也提供集成了基础软件栈的容器镜像。

2.2 获取并运行Ollama

Ollama的安装非常 straightforward。在终端中执行以下命令即可:

# 使用官方一键安装脚本

curl -fsSL https://ollama.ai/install.sh | sh

# 安装完成后,启动Ollama服务

ollama serve

ollama serve命令会在后台启动一个服务。之后,你就可以通过命令行或者Web界面来与Ollama交互,拉取和管理模型了。

关键点:在昇腾平台上,需要确保Ollama的进程能够正确调用到昇腾的AI计算库。如果遇到问题,可能需要检查环境变量(如ASCEND_TOOLKIT_PATH)是否设置正确,或者查阅昇腾平台关于运行第三方AI框架的文档。

3. 拉取与运行translategemma-4b-it模型

当Ollama服务跑起来之后,接下来的步骤就和我们平时在x86机器上操作几乎一样了,这正体现了Ollama的良好封装性。

3.1 从Ollama拉取模型

打开一个新的终端窗口,输入以下命令来拉取translategemma模型:

ollama pull translategemma:4b

这个命令会从Ollama的模型库中下载translategemma:4b这个标签对应的模型文件。下载时间取决于你的网络速度,因为模型有好几个GB大小。

3.2 启动模型进行推理

模型拉取成功后,你可以使用run命令来启动它并直接进行交互:

ollama run translategemma:4b

执行这个命令后,你会进入一个交互式命令行界面,提示符可能会变成>>>,这意味着模型已经加载好,等待你输入了。不过,对于图文翻译任务,我们更常用的是通过Ollama提供的API接口来调用,这样更方便集成到其他应用中。

另一种方式:作为API服务运行 你可以让Ollama以API服务的形式在后台运行模型:

# 启动模型服务,监听11434端口(Ollama默认端口)

ollama run translategemma:4b &

然后,你就可以通过向http://localhost:11434/api/generate发送HTTP POST请求来调用模型了。这对于开发应用来说非常灵活。

4. 图文翻译功能实践与验证

模型跑起来了,是骡子是马,得拉出来溜溜。我们重点测试它的核心功能:图文翻译。

4.1 纯文本翻译测试

我们先从最简单的开始,验证其基础翻译能力。通过curl命令调用Ollama的API:

curl http://localhost:11434/api/generate -d '{

"model": "translategemma:4b",

"prompt": "你是一名专业的英语(en)至中文(zh-Hans)翻译员。你的目标是准确传达原文的含义与细微差别,同时遵循英语语法、词汇及文化敏感性规范。仅输出中文译文,无需额外解释或评论。请翻译以下文本:\\\"The rapid advancement of artificial intelligence is reshaping every industry.\\\"",

"stream": false

}'

预期与结果:模型应该会忽略前面的指令描述(因为它本身已定义为翻译模型),直接输出中文译文:“人工智能的快速发展正在重塑每一个行业。” 这个测试确保了模型的基础文本翻译管道是通畅的。

4.2 核心挑战:图文翻译验证

这才是本次实践的重头戏。translategemma-4b-it宣称支持图像输入,我们需要验证在昇腾910B平台上,这一功能是否正常工作。

步骤一:准备测试图片 找一张包含英文文字的图片,例如一张英文产品说明书截图、一个英文路牌照片,或者一句英文名言的海报。将其保存为test_image.jpg。为了严谨,我们可以用一个简单的Python脚本生成一张测试图:

from PIL import Image, ImageDraw, ImageFont

# 创建一个白色背景的图片

img = Image.new('RGB', (800, 200), color='white')

d = ImageDraw.Draw(img)

# 尝试加载字体,如果失败则使用默认字体

try:

font = ImageFont.truetype("arial.ttf", 40)

except:

font = ImageFont.load_default()

# 在图片上写一句英文

d.text((50, 80), "Welcome to the future of translation.", fill='black', font=font)

img.save("test_image.jpg")

print("测试图片已生成:test_image.jpg")

步骤二:构建包含图像的请求 Ollama的API支持以Base64格式传递图像。我们需要将图片编码,并构造一个特殊的提示词。

# 首先,将图片转换为Base64编码(这里用Python示例,也可用其他工具)

python3 -c "

import base64

with open('test_image.jpg', 'rb') as f:

img_base64 = base64.b64encode(f.read()).decode('utf-8')

print('图片Base64编码(前100字符):', img_base64[:100])

"

# 假设得到的Base64字符串为 IMG_BASE64_CONTENT

# 然后构造请求。注意,prompt里需要明确指出图像的存在。

curl http://localhost:11434/api/generate -d '{

"model": "translategemma:4b",

"prompt": "你是一名专业的英语(en)至中文(zh-Hans)翻译员。你的目标是准确传达原文的含义与细微差别,同时遵循英语语法、词汇及文化敏感性规范。仅输出中文译文,无需额外解释或评论。请将图片中的英文文本翻译成中文:",

"images": ["IMG_BASE64_CONTENT"],

"stream": false

}'

关键点分析:

- 提示词(Prompt):我们明确指令“请将图片中的英文文本翻译成中文”,这告诉模型需要处理图像输入。

- 图像字段(images):请求JSON中的

images数组包含了图片的Base64数据,这是Ollama API规定的传递图像的方式。 - 模型内部处理:translategemma-4b-it模型接收到这些数据后,会先对图像进行预处理(如缩放、特征提取),识别出其中的文本,再执行翻译流程。

步骤三:结果分析 如果一切顺利,API将返回一个JSON响应,其中的response字段应该包含翻译好的中文文本,例如:“欢迎来到翻译的未来。”

成功标志:

- API返回了合理的中文译文。

- 译文准确对应了图片中的英文内容。

- 响应中没有出现图像处理错误或模型不理解图像的报错。

如果在昇腾910B平台上完成了以上步骤并得到了正确结果,那么我们就可以初步认定:translategemma-4b-it模型的图文翻译功能在国产昇腾910B硬件上通过Ollama部署是基本可行的。

5. 实践总结与展望

通过这一系列的步骤,我们从零开始,成功地在昇腾910B平台上使用Ollama部署并初步验证了translategemma-4b-it模型的图文翻译能力。

5.1 本次实践的核心收获

- 技术路径验证:证明了“Ollama + 开源AI模型 + 昇腾硬件”这一技术组合的可行性。它为在国产化环境中快速部署和应用前沿AI模型提供了一个可参考的范例。

- 功能可用性确认:验证了translategemma-4b-it模型的核心卖点——图文翻译在目标平台上的基本功能是正常的。这对于需要处理扫描文档、图片资料翻译的应用场景具有实际价值。

- 流程标准化:整个过程展示了使用Ollama部署模型的标准化流程,从环境准备、模型拉取到API调用,步骤清晰,可重复性强。

5.2 遇到的可能问题与思考

在适配过程中,可能会遇到一些典型问题,这也是工程实践的一部分:

- 性能表现:在昇腾910B上的推理速度与同等算力的其他平台对比如何?这需要进一步的量化基准测试。

- 精度验证:图文翻译的准确率,尤其是对复杂排版、手写体、低质量图像的识别翻译能力,需要更全面的测试集来评估。

- 生态兼容:是否所有Ollama支持的模型都能无缝迁移到昇腾平台?可能某些模型依赖了特定算子,需要额外的适配工作。

5.3 下一步可以做什么?

这次的实践只是一个起点,未来可以沿着几个方向深入:

- 性能优化:探索利用昇腾CANN提供的更底层接口或优化工具,对模型推理过程进行深度优化,提升吞吐量和降低延迟。

- 多模型测试:将更多Ollama模型库中的优秀模型(如Llama、Mistral等)在昇腾平台进行部署验证,丰富国产算力上的模型生态。

- 应用集成:基于这个可用的翻译服务,开发一个简单的演示应用,例如一个允许用户上传图片并获取翻译结果的网页工具,让价值更直观地呈现出来。

获取更多AI镜像

想探索更多AI镜像和应用场景?访问 CSDN星图镜像广场,提供丰富的预置镜像,覆盖大模型推理、图像生成、视频生成、模型微调等多个领域,支持一键部署。

昇腾计算产业是基于昇腾系列(HUAWEI Ascend)处理器和基础软件构建的全栈 AI计算基础设施、行业应用及服务,https://devpress.csdn.net/organization/setting/general/146749包括昇腾系列处理器、系列硬件、CANN、AI计算框架、应用使能、开发工具链、管理运维工具、行业应用及服务等全产业链

更多推荐

已为社区贡献3条内容

已为社区贡献3条内容

所有评论(0)