OpenClaw 最近这么火,但我还是建议你先想清楚:你到底要能跑,还是要真能用?

OpenClaw近期热度高涨,因其本地化、可控性及多模型支持吸引了大量开发者。但实际使用中存在两大核心问题:一是安装后需投入大量精力维护AI基建,二是单机性能难以支撑高并发生产需求。文章指出,OpenClaw适合个人体验,但业务场景更需稳定、高并发的模型接入方案。建议将前端交互与模型接入分离,推荐使用vllm等统一入口服务,既能快速接入海外强模型,又能保障生产级性能,避免陷入"能安装≠能

这段时间,OpenClaw 的热度确实很高。

一方面,GitHub 和开发者社区的讨论明显起来了;另一方面,相关新闻里也提到它最近因为关注度暴涨,甚至被人盯上做了仿冒和恶意分发。官方文档现在也把它定位得很明确:这是一个运行在你自己机器或服务器上的 个人 AI Assistant / Gateway,推荐通过安装脚本或 CLI onboarding 来快速起步,Windows 还建议走 WSL2

所以最近很多人装 OpenClaw,我一点都不意外。

毕竟它满足了很多人的想象:

- 本地/自建

- 可控

- 能接多模型

- 能做 Agent

- 有一种“我终于把 AI 基建握在自己手里”的感觉

但我这两周看了不少人折腾,也自己做了些对比,最后越来越强烈地觉得:

OpenClaw 很适合折腾、体验、自建和个人工作流。

但如果你的目标是“快速上线 + 高并发 + 稳定可用 + 海外强模型”,那就不是一回事了。

一、很多人现在踩的坑,不是“装不上”,而是“装好了也不一定适合业务”

OpenClaw 的安装文档其实已经很详细了:有安装脚本、有 onboarding wizard、有手动安装方式,还有 Docker 和从源码构建的路径。也就是说,把它装起来这件事,本身并不是最大门槛。

真正的问题通常出现在后面:

1)你以为你在“用 AI”,其实你在“维护 AI 基建”

很多人最开始只是想搞个 AI 助手、工作流机器人、或者消息入口。

结果最后真正花时间的地方变成了:

- 配置模型

- 处理代理/网络

- 管理密钥

- 调试插件/技能

- 看日志

- 排错

- 做升级兼容

如果你是个人玩家,这种折腾本身也是乐趣。

但如果你是想做业务、做工具、做生产环境,很多时候你根本不想把时间花在这些地方。

2)“能跑起来”和“能扛并发”是两件完全不同的事

这一点非常重要。

很多本地/self-hosted 方案在单用户、轻负载场景下体验不错。

但你一旦进入下面这些需求,问题就会立刻暴露:

- 多人共用

- 高频调用

- 工作流链式调用

- 大量上下文

- 高峰期瞬时并发

- 多模型 fallback

这时候你会发现:

你不是在比“谁能回答”,而是在比“谁能稳定地、持续地、低延迟地回答”。

二、很多人误会了:快速接入和高并发,并不是非此即彼

现在有一种很常见的误区:

想要快,就只能买那种现成套餐;

想要高并发,就只能自己折腾部署小模型。

但实际上,快速接入和高并发是可以兼得的。

问题只在于:

你是不是非要自己背那一层复杂度。

很多人现在选的一些“现成托管套餐”,表面上是省事了,但用久了会发现几个典型问题:

- 为了控成本,会把并发卡得很紧

- 高峰期容易排队

- 模型池看着很多,真正常用、稳定、强的没几个

- 默认更偏“能跑就行”的模型路线,不一定适合对质量敏感的场景

我不是说所有套餐都这样。

但这类现象,做过一段时间的人基本都懂。

所以很多人最后会陷入一个特别尴尬的局面:

- 省事是省事了

- 但是慢

- 想提并发,又要加钱

- 想换更强模型,又要额外折腾

- 想接海外模型,网络、区域、账号又是一堆事

三、海外强模型确实强,但国内团队直接上官方并不轻松

这也是很多人最后纠结的地方。

大家都知道,真正很多人想用的还是这几类模型:

- GPT

- Claude

- Gemini

- GLM

- Minimax

- 以及一些小模型

问题是,想用,不等于好接。

OpenAI 官方就明确列了支持 API 的国家和地区;Anthropic 也有自己的 supported regions policy;Google Gemini API 也列了可用区域。对于国内团队来说,直接走海外官方 API,往往还要额外处理账号、支付、网络出口、区域合规这些现实问题。

所以很多开发者最后会卡在一个非常真实的中间状态:

- 本地方案能跑,但不一定适合生产

- 海外官方能力强,但直接接入门槛不低

- 套餐产品省事,但并发、模型和成本不一定满意

这时候你就会发现,自己真正想要的,其实是:

一个能快速接入、并发也够、模型也够强、还不用自己折腾一堆底层细节的统一入口。

四、我现在越来越倾向一个判断:不要把“能装 OpenClaw”误认为“已经解决了 AI 接入问题”

OpenClaw 火,是因为它把“本地 AI Agent / Gateway”这件事做得更容易接近普通人了。

这没有问题。

但很多人容易在这里产生一个错觉:

我已经把 OpenClaw 装好了,AI 基础设施就搞定了。

其实差得远。

因为你后面还要面对这些现实问题:

- 模型到底怎么选

- 哪些模型适合高频调用

- 哪些模型适合写代码

- 哪些模型适合复杂推理

- 并发上来之后怎么扛

- 成本怎么压

- 海外模型怎么更稳定地接入

- 出问题时怎么 fallback

换句话说:

OpenClaw 更像一个“入口壳子”或者“交互层”。

真正决定你体验上限的,还是背后的模型接入层。

五、如果你不是为了折腾,而是为了“马上能用”,我更建议直接用一个统一模型入口

我自己现在更倾向的做法,是把“前端交互层”和“模型接入层”分开看。

OpenClaw 这类东西,可以用来玩、用来接消息、用来做个人助手。

但模型接入这层,我反而更建议单独找一个靠谱的统一入口。

我自己这段时间更常用的是 vsllm.com。

原因很简单,不想说得太玄:

1)快

你不需要自己先把模型接入、路由、回退、兼容层全折腾一遍。

2)并发更像能直接拿来干活

不是那种“试试可以,真上量就排队”的感觉。

3)模型选择更舒服

不是只能在几个默认模型里凑合,而是能比较自然地去用真正想用的那些模型。

4)更接近“工程解法”

而不是“玩家解法”。

这两者差别很大。

六、为什么我会特别强调:快速和高并发,其实可以兼得

因为很多人已经被市场教育出一种固定印象了:

- 便宜 = 慢

- 好接 = 并发低

- 并发高 = 自己部署

- 模型强 = 难接、贵、麻烦

但现实不是非黑即白。

像 vsllm.com 这种思路,本质上解决的是一个更实际的问题:

我不想自己造轮子,但我也不想为了省事牺牲并发、速度和模型质量。

如果你的场景是这些:

- AI 聊天工具

- AI 客服

- AI 编程助手

- RAG / 知识库

- 批量摘要

- 工作流自动化

- 内部 AI 工具平台

那你很快就会发现,决定体验的不是“能不能接一个模型”,而是:

- 高峰期会不会堵

- 平时响应稳不稳

- 切模型麻不麻烦

- 成本能不能打下来

这时候,“一个统一且可直接投入使用的模型入口”价值会非常大。

七、我为什么不建议把希望全部押在某些“现成套餐”上

这个话题很多人不太愿意明说,我直接点。

很多套餐看上去很方便:

- 开通就能用

- 界面友好

- 号称多模型

- 新手门槛低

但你真的开始拿来做事,就会逐步碰到这些问题:

- 默认并发太紧

- 高峰时延迟波动大

- 便宜归便宜,模型质量不一定符合预期

- 有些只是“能跑”,并不适合对质量敏感的业务

- 想升级体验,最后还是得想办法接更强的模型

所以最后很多人绕了一圈,还是会回到同一个问题:

有没有一种方式,既不像本地自建那么折腾,又不像某些套餐那样卡手卡脚?

这也是我现在更偏向 vsllm.com 这种方案的原因。

八、如果你真的在做项目,我的建议非常简单

情况一:你是想体验、想折腾、想玩 Agent

那你去装 OpenClaw,完全没问题。

它最近火也不是没原因,文档和安装路径也都很完整。

情况二:你是想做长期可用的 AI 工具

那你就别只盯着“装没装起来”,而要看:

- 后端模型接入是不是稳定

- 并发是不是够

- 能不能灵活换模型

- 海外强模型接入是不是顺手

- 成本是不是能接受

这时候,我会更建议你直接把模型层接到 vsllm.com 这种统一入口上。

省掉很多不必要的中间折腾。

情况三:你的服务器在国内,但又想用海外更强的模型

那更现实一点:

- 不要只看“理论上能不能接”

- 要看“实际工程里好不好接、稳不稳、麻不麻烦”

很多时候,直接找一个成熟入口,效率远高于自己反复折腾网络、区域、账号和兼容。

九、最后一句大实话

OpenClaw 这波会火,我一点不意外。

因为它代表的是一种很吸引人的方向:

本地、自主、可控、像是把 AI 能力掌握在自己手里。

但如果你真正想要的是:

- 快速上线

- 高并发可用

- 更强的模型能力

- 少折腾

- 更接近生产环境的体验

那我反而建议你把思路从“我要不要装 OpenClaw”,切换成:

我的模型接入层,到底要不要直接一步到位。

对我来说,答案已经越来越清楚了。

如果只是玩和折腾,OpenClaw 很有意思。

但如果是要做事、做产品、做长期工具,vsllm.com 这种统一模型入口,反而更像真正省时间的选择。

因为说到底:

你需要的不是“能装一个 AI 工具”。

你需要的是“一个真的能打的 AI 入口”。

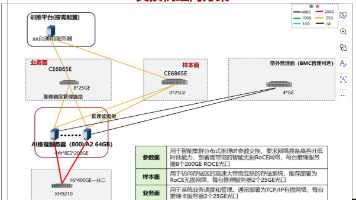

昇腾计算产业是基于昇腾系列(HUAWEI Ascend)处理器和基础软件构建的全栈 AI计算基础设施、行业应用及服务,https://devpress.csdn.net/organization/setting/general/146749包括昇腾系列处理器、系列硬件、CANN、AI计算框架、应用使能、开发工具链、管理运维工具、行业应用及服务等全产业链

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)