云原生视角下的计算平台资源虚拟化与切分技术实现:深度解读 ge 仓库

云原生视角下的计算平台资源虚拟化与切分技术实现:深度解读 ge 仓库

在异构计算与云原生技术深度融合的今天,如何高效、灵活地调度算力资源已成为大模型时代的必修课。作为 CANN (Compute Architecture for Neural Networks) 生态中的核心组件,ge(Graph Engine)承担着连接上层框架与底层硬件抽象层的关键角色,是实现计算图编译、优化及资源管理的核心大脑。

本文将从资深架构专家的视角,深入解析计算平台在资源虚拟化与算力切分方面的核心逻辑,并探讨其在图引擎层面的架构支撑。

1. 核心定位:图引擎与资源的协同

在计算平台架构中,ge 位于前端框架与底层执行逻辑之间。它不仅负责将计算图转化为可执行的序列,更重要的是,它需要感知底层的硬件拓扑。与传统的资源上报机制不同,在 CANN 兼容系统中,图引擎能够针对芯片特性(如算力单元分布、显存空间分配等)进行深度定制,实现从逻辑算力单元到物理执行流的精准映射。

2. 算力切分的实现逻辑:虚拟化与动态分配

在云原生多租户场景下,为了提高资源利用率,系统引入了算力切分的深度优化方案。

2.1 资源抽象与逻辑映射

在架构设计中,系统通过管理接口周期性地感知底层硬件状态。

- 物理模式:将完整的硬件计算单元直接暴露给上层任务。

- 切分模式:根据配置模板,将物理芯片的计算核心与显存划分为多个逻辑孤岛。例如,将单体硬件切分为多个具有独立算力占用的规格块。

在 ge 的资源管理模块中,定义了不同型号芯片的算力描述。通过调用底层系统管理接口,图引擎能够获取当前芯片的虚拟化能力集,并在编译阶段进行针对性的算子排布优化。

2.2 核心调度原理:从算力分配到任务下发

当上层应用请求特定规格的虚拟化资源时,核心调度逻辑如下:

- 设备选择与状态维护:系统维护内部状态机,记录每个物理单元的剩余算力和显存。调度算法会优先匹配碎片率最低的物理芯片,以减少资源浪费。

- 静态与动态切分支撑:对于支持动态切分的硬件型号,系统通过驱动接口实时下发指令,在内核态构建逻辑上的虚拟设备。

- 上下文隔离:这是确保多租户安全的关键。系统通过为每个逻辑单元分配独立的上下文环境,确保不同任务间的指令流与数据流互不干扰。

3. 深度架构解析:虚拟化切分的关键路径

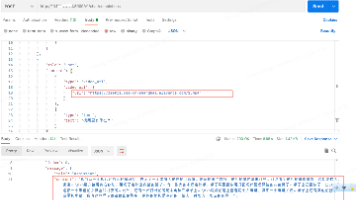

在 ge 的源码架构中,其内存管理与流调度模块负责核心的资源管控。

3.1 预处理与环境校验

为了保证计算任务启动时环境的洁净,系统在任务载入前会执行严格的预检。图引擎会检查虚拟设备的状态,如果物理链路发生异常或硬件告警,系统会及时捕获并触发上层框架的重新调度机制。

3.2 算子库与执行环境的绑定

高性能算子的运行依赖于庞大的计算库支撑,尤其是基于 Ascend C 编程范式开发的内核。在资源分配阶段,系统不仅挂载了设备文件,还会自动关联以下核心组件:

- 运行时驱动库路径

- 设备通信管理接口

- 硬件抽象层管理单元

这种“算力即插即用”的机制,极大地简化了容器化环境下的部署复杂度。

4. 故障隔离与可靠性保障

在异构计算中,硬件健康管理至关重要。计算平台实现了一套完备的监控机制:

- 状态监测:通过系统接口实时获取芯片健康度及温度、功耗等指标。

- 热隔离技术:一旦检测到某个虚拟化单元发生不可恢复的校验错误,系统会立即将其标记为不可用,防止新任务调度,并配合检查点机制实现业务减损。

5. 架构师总结

ge 仓库所代表的图引擎技术,是整个计算平台算力底座在云原生时代的延伸。

通过对计算图编译、资源分配以及底层接口的深度封装,它实现了:

- 细粒度资源管控:大幅提升昂贵硬件资源的整体利用率。

- 拓扑感知调度:确保分布式训练与推理时的通信效率最优。

- 运维自动化:屏蔽了底层硬件复杂的初始化与管理逻辑。

对于架构师而言,深入研究该仓库的逻辑,不仅能理解高性能计算资源的分配原理,更能掌握 AI 栈中软硬件协同设计的精髓。

cann 组织链接:https://atomgit.com/cann

ge 仓库链接:https://atomgit.com/cann/ge

昇腾计算产业是基于昇腾系列(HUAWEI Ascend)处理器和基础软件构建的全栈 AI计算基础设施、行业应用及服务,https://devpress.csdn.net/organization/setting/general/146749包括昇腾系列处理器、系列硬件、CANN、AI计算框架、应用使能、开发工具链、管理运维工具、行业应用及服务等全产业链

更多推荐

已为社区贡献33条内容

已为社区贡献33条内容

所有评论(0)