Llama guard的启动部署以及利用llama Factory的微调

本文记录通过vLLM将llama guard在服务器端进行部署并进行模型微调的过程。由于一些文档不完善,本文尽可能提供了一些常见问题解决方案,以及配置方法供大家参考。

本文记录通过vLLM将llama guard在服务器端进行部署并进行模型微调的过程。由于一些文档不完善,本文尽可能提供了一些常见问题解决方案,以及配置方法供大家参考。

link

- llama stack

- llama guard 3-1 B

- Xpost

利用Vllm启动服务并部署

利用conda创建虚拟环境

conda create -n <env name> python=<python 版本>conda env listconda activate <env name>pip list

模型下载

- 3-1 b 模型地址 (测试后发现3-1b 非常垃圾,不建议使用)

huggingface-cli login, 输入token- 这里需要在hugging face 上登录认证并签署协议,等待5-10min认证通过即可。

- 安装lfs工具,

git lfs install - git clone

<hugging face url>

另外一种方法是在代码中直接运行,如果没有的话会自动下载

tokenizer = AutoTokenizer.from_pretrained("<model name>",catch_dir=catch_dir,token=''), 这里

启动服务 vLLM

<指定GPU> python -m vllm.entrypoints.openai.api_server --port 5123 --model meta-llama/Llama-Guard-3-1B

指定GPU运行

- 检查GPU使用情况:

nvidia-smi - 查看具体某个GPU使用情况:

nvidia-smi -q -i 7 - 指定GPU运行:

CUDA_VISIBLE_DEVICES=6,7

发送请求

import requests

url = "http://localhost:5123/v1/chat/completions"

headers = {

"Content-Type": "application/json"

}

data = {

"model": "meta-llama/Llama-Guard-3-1B",

"messages": [

{"role": "user", "content": "Hello!"}

]

}

response = requests.post(url, headers=headers, json=data)

另外一种方法:

from openai import OpenAI

client = OpenAI(

base_url="http://localhost:5123/v1",

api_key=" ",

)

completion = client.chat.completions.create(

model="meta-llama/Llama-Guard-3-8B",

messages=[

{"role": "user", "content": content}

],

temperature=0

)

print(completion.choices[0].message.content)

查看模型是成功运行。

查看端口占用情况

lsof -inetstat -anp|grep 5123

利用LLaMA-Factory进行微调

-

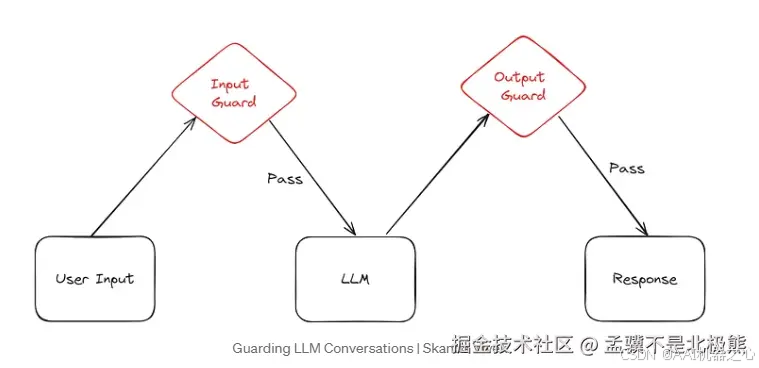

如图所示, llama guard实际上的输入信息是一组对话,对于流式生成来说,是没有办法拦截生成对话的。因此,我们决定对模型进行调整:

-

- 增加训练语料,添加多轮对话缺少最后一次Agent生成的数据

-

- 添加其他训练类别的数据

-

下载并配置llama factory

数据格式

"""<|image|> Task: Check if there is unsafe content in '{role}' messages in conversations according to our safety policy with the below categories.

<BEGIN UNSAFE CONTENT CATEGORIES>

{unsafe_categories}

<END UNSAFE CONTENT CATEGORIES>

<BEGIN CONVERSATION>

{conversation}

<END CONVERSATION>

Provide your safety assessment for ONLY THE LAST {role} in the above conversation:

- First line must read 'safe' or 'unsafe'.

- If unsafe, a second line must include a comma-separated list of violated categories."""

更多可以参考: meta llama-guard-3

- 一定要注意换行、空格、缩进等

- 数据格式需要符合llama factory的要求 [ “instruction”: “”, “input”:“”, “output”:“” ] 其中

instruction输入prompt内容,output输入期待输出。 在LLaMA-Factory/data/dataset_info.json中添加你的数据集名称和地址。

yaml 文件配置

更改配置文件lora_sft_ds3.yaml

model_name_or_path

### dataset

dataset <同dataset_info中的地址>

template: llama3

cutoff_len: 4096 <这里需要查model card确认>

### train

per_device_train_batch_size: 1

gradient_accumulation_steps: 2

learning_rate: 1.0e-4

num_train_epochs: 3.0

lr_scheduler_type: cosine

warmup_ratio: 0.1

bf16: true

ddp_timeout: 180000000

### eval

val_size: 0.1

per_device_eval_batch_size: 1

eval_strategy: steps

eval_steps: 5000000

这里我们选用了Lora进行微调。LoRA是一种新型的微调方法,旨在解决预训练模型微调过程中存在的两大问题:模型调整过程中对初始模型过度依赖以及微调过程中存在的过拟合问题。LoRA通过在预训练模型中引入一个额外的线性层,并使用特定任务的训练数据来微调这个线性层。这种方法使模型能够更好地适应特定任务,同时减少了对初始模型的过度依赖。

微调参数

- learning_rate: 1.0e-5 是Meta官方推荐,不建议更改。

- gradient_accumulation_steps * per_device_train_batch_size * save_steps = max_samples

- 批大小batch size

- effective_batch_size = batch_size * gradient_acc_step

运行程序

注意,因为配置文件中用了相对路径,所以必须在llamafactory根目录下启动程序: CUDA_VISIBLE_DEVICES=6,7 llamafactory-cli train /home/feiyu_jiang/LLaMA-Factory/examples/train_lora/llama_guard_lora_sft_ds3.yaml

启动微调后的模型

因为我们使用lora进行模型微调的,所以模型本身名称没有改变。添加参数 --lora-modules '{"name": "sql-lora", "path": "/path/to/lora", "base_model_name": "meta-llama/..."}启动即可。

eg: python -m vllm.entrypoints.openai.api_server --port 5123 --model meta-llama/Llama-Guard-3-8B --enable-lora --lora-modules sql-lora=<path>

附录:常见报错

undefined symbol: __nvJitLinkAddData_12_1, version libnvJitLink.so.121,2

-

错误原因:表明您的系统中缺少一个名为

__nvJitLinkAddData_12_1的符号定义, pyTorch 与 nvidia的动态库没有正确链接3 -

解决方法

-

切换conda环境(guard-vllm)

-

检查torch版本:

pip show torch -

检查CUDA版本:

nvcc -v -

检查CUDA环境变量地址:

echo $LD_LIBRARY_PATH -

添加CUDA路径:

export LD_LIBRARY_PATH="/usr/local/cuda/lib64:$LD_LIBRARY_PATH" -

搜错动态链接库:

find ~/ -name "libnvJitLink.so.12"/home/<user_name>miniconda3/envs/guard-vllm/lib/python3.10/site-packages/nvidia/nvjitlink/lib/libnvJitLink.so.12 -

添加临时环境变量

export LD_PRELOAD="/home/<user_name>/miniconda3/envs/guard-vllm/lib/python3.10/site-packages/nvidia/nvjitlink/lib/libnvJitLink.so.12" -

如何嫌弃太麻烦,可以直接写在

home../.bashrc里面,每次启动终端自动加载

-

-

另外,也可以选择降级torch到稳定版本

想入门 AI 大模型却找不到清晰方向?备考大厂 AI 岗还在四处搜集零散资料?别再浪费时间啦!2026 年 AI 大模型全套学习资料已整理完毕,从学习路线到面试真题,从工具教程到行业报告,一站式覆盖你的所有需求,现在全部免费分享!

👇👇扫码免费领取全部内容👇👇

一、学习必备:100+本大模型电子书+26 份行业报告 + 600+ 套技术PPT,帮你看透 AI 趋势

想了解大模型的行业动态、商业落地案例?大模型电子书?这份资料帮你站在 “行业高度” 学 AI:

1. 100+本大模型方向电子书

2. 26 份行业研究报告:覆盖多领域实践与趋势

报告包含阿里、DeepSeek 等权威机构发布的核心内容,涵盖:

- 职业趋势:《AI + 职业趋势报告》《中国 AI 人才粮仓模型解析》;

- 商业落地:《生成式 AI 商业落地白皮书》《AI Agent 应用落地技术白皮书》;

- 领域细分:《AGI 在金融领域的应用报告》《AI GC 实践案例集》;

- 行业监测:《2024 年中国大模型季度监测报告》《2025 年中国技术市场发展趋势》。

3. 600+套技术大会 PPT:听行业大咖讲实战

PPT 整理自 2024-2025 年热门技术大会,包含百度、腾讯、字节等企业的一线实践:

- 安全方向:《端侧大模型的安全建设》《大模型驱动安全升级(腾讯代码安全实践)》;

- 产品与创新:《大模型产品如何创新与创收》《AI 时代的新范式:构建 AI 产品》;

- 多模态与 Agent:《Step-Video 开源模型(视频生成进展)》《Agentic RAG 的现在与未来》;

- 工程落地:《从原型到生产:AgentOps 加速字节 AI 应用落地》《智能代码助手 CodeFuse 的架构设计》。

二、求职必看:大厂 AI 岗面试 “弹药库”,300 + 真题 + 107 道面经直接抱走

想冲字节、腾讯、阿里、蔚来等大厂 AI 岗?这份面试资料帮你提前 “押题”,拒绝临场慌!

1. 107 道大厂面经:覆盖 Prompt、RAG、大模型应用工程师等热门岗位

面经整理自 2021-2025 年真实面试场景,包含 TPlink、字节、腾讯、蔚来、虾皮、中兴、科大讯飞、京东等企业的高频考题,每道题都附带思路解析:

2. 102 道 AI 大模型真题:直击大模型核心考点

针对大模型专属考题,从概念到实践全面覆盖,帮你理清底层逻辑:

3. 97 道 LLMs 真题:聚焦大型语言模型高频问题

专门拆解 LLMs 的核心痛点与解决方案,比如让很多人头疼的 “复读机问题”:

三、路线必明: AI 大模型学习路线图,1 张图理清核心内容

刚接触 AI 大模型,不知道该从哪学起?这份「AI大模型 学习路线图」直接帮你划重点,不用再盲目摸索!

路线图涵盖 5 大核心板块,从基础到进阶层层递进:一步步带你从入门到进阶,从理论到实战。

L1阶段:启航篇丨极速破界AI新时代

L1阶段:了解大模型的基础知识,以及大模型在各个行业的应用和分析,学习理解大模型的核心原理、关键技术以及大模型应用场景。

L2阶段:攻坚篇丨RAG开发实战工坊

L2阶段:AI大模型RAG应用开发工程,主要学习RAG检索增强生成:包括Naive RAG、Advanced-RAG以及RAG性能评估,还有GraphRAG在内的多个RAG热门项目的分析。

L3阶段:跃迁篇丨Agent智能体架构设计

L3阶段:大模型Agent应用架构进阶实现,主要学习LangChain、 LIamaIndex框架,也会学习到AutoGPT、 MetaGPT等多Agent系统,打造Agent智能体。

L4阶段:精进篇丨模型微调与私有化部署

L4阶段:大模型的微调和私有化部署,更加深入的探讨Transformer架构,学习大模型的微调技术,利用DeepSpeed、Lamam Factory等工具快速进行模型微调,并通过Ollama、vLLM等推理部署框架,实现模型的快速部署。

L5阶段:专题集丨特训篇 【录播课】

四、资料领取:全套内容免费抱走,学 AI 不用再找第二份

不管你是 0 基础想入门 AI 大模型,还是有基础想冲刺大厂、了解行业趋势,这份资料都能满足你!

现在只需按照提示操作,就能免费领取:

👇👇扫码免费领取全部内容👇👇

2026 年想抓住 AI 大模型的风口?别犹豫,这份免费资料就是你的 “起跑线”!

昇腾计算产业是基于昇腾系列(HUAWEI Ascend)处理器和基础软件构建的全栈 AI计算基础设施、行业应用及服务,https://devpress.csdn.net/organization/setting/general/146749包括昇腾系列处理器、系列硬件、CANN、AI计算框架、应用使能、开发工具链、管理运维工具、行业应用及服务等全产业链

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)